KI-Integration

Pro-Funktion

KI-Kontextdateien erfordern eine Pro-Lizenz.

Nutzen Sie KI-Assistenten, um Ihre Performance-Daten zu analysieren und Optimierungsvorschläge zu erhalten.

So funktioniert es

Abschnitt betitelt „So funktioniert es“GalataJ erstellt automatisch Kontextdateien, die KI-Assistenten lesen können:

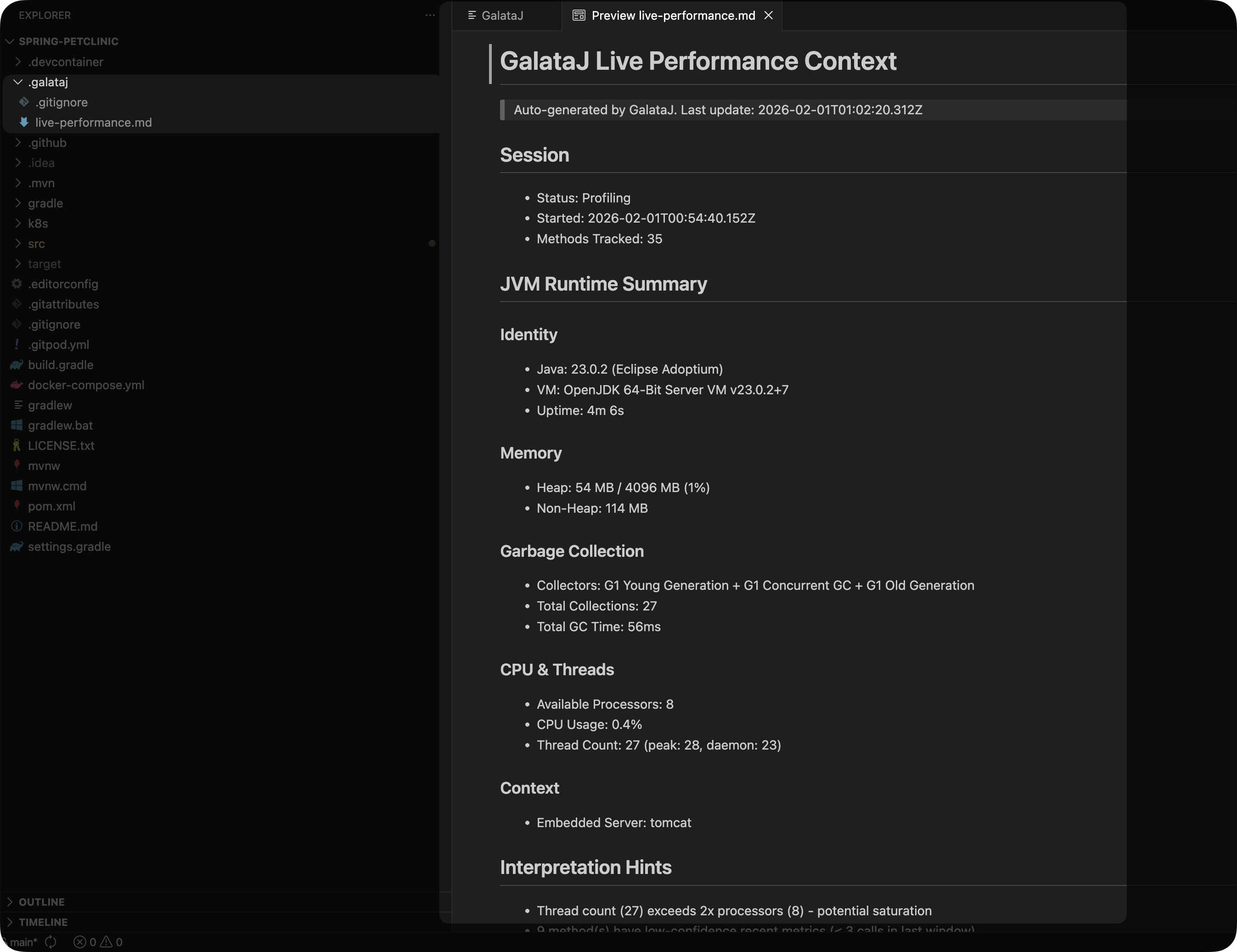

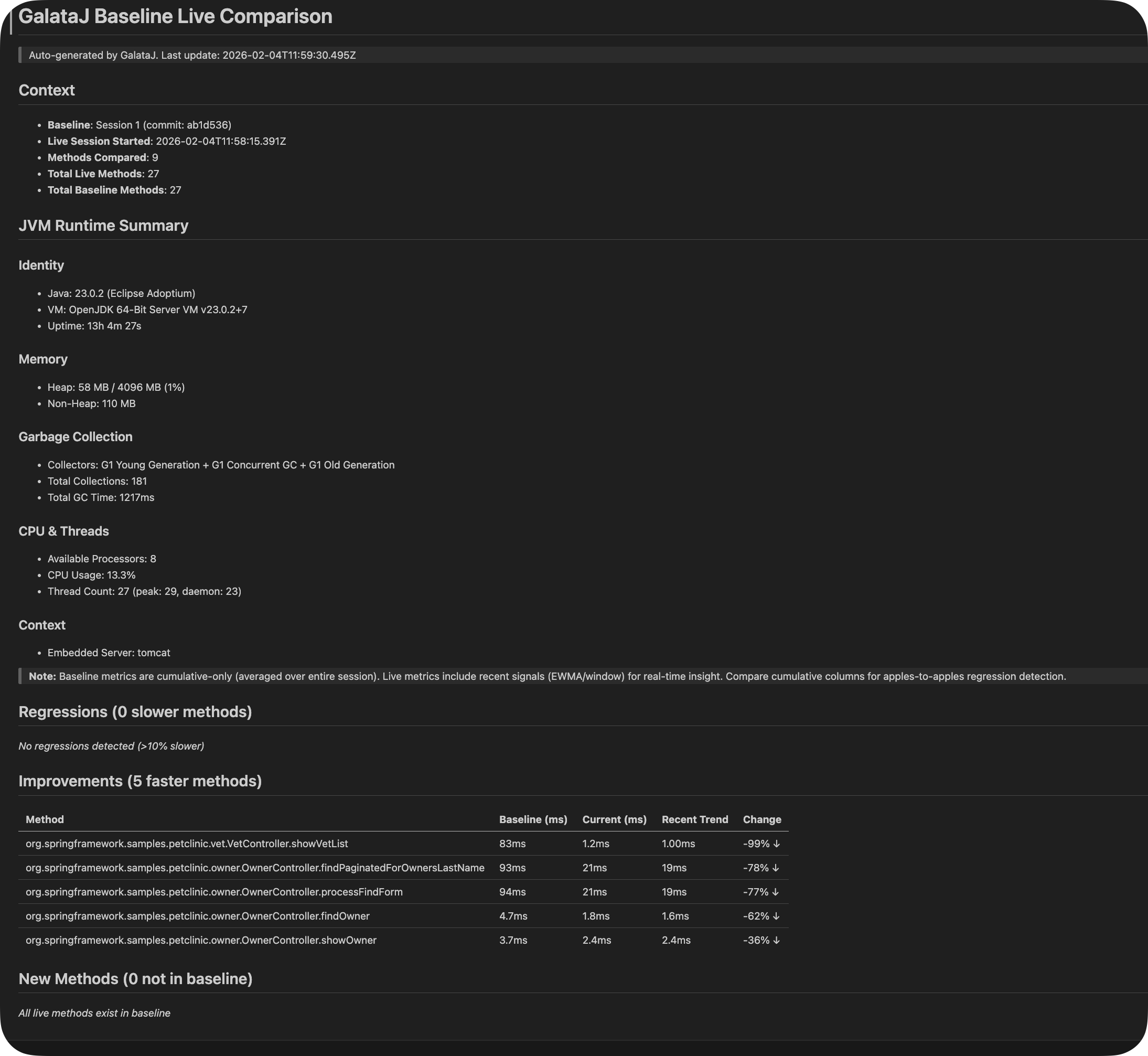

your-project/├── .galataj/│ ├── live-performance.md ← Aktuelle Profiling-Daten│ └── baseline-live-compare.md ← Vergleich mit BaselineRichten Sie Ihren KI-Assistenten auf diese Dateien aus und stellen Sie Performance-Fragen.

Live-Performance-Datei

Abschnitt betitelt „Live-Performance-Datei“live-performance.md enthält Echtzeit-Profiling-Daten im KI-Format:

- Top-Methoden nach CPU-Zeit

- Aufrufzahlen und Allokationen

- JVM-Laufzeit-Zusammenfassung

- Kontext-Erkennungsergebnisse

Wird automatisch aktualisiert, während das Profiling aktiv ist.

Baseline-Vergleichsdatei

Abschnitt betitelt „Baseline-Vergleichsdatei“baseline-live-compare.md zeigt, wie sich die aktuelle Performance zur Baseline verhält:

- Langsamer gewordene Methoden (Regressionen)

- Schneller gewordene Methoden (Verbesserungen)

- Zusammenfassende Statistiken

Wird automatisch aktualisiert, während das Profiling aktiv ist.

Mit KI-Assistenten nutzen

Abschnitt betitelt „Mit KI-Assistenten nutzen“Cursor / Windsurf

Abschnitt betitelt „Cursor / Windsurf“Datei direkt referenzieren:

- “Lies @.galataj/live-performance.md und schlage Optimierungen für die langsamsten Methoden vor”

- “Lies die Datei ‘@.galataj/baseline-live-compare.md’ und sieh, wie sich die Performance nach dem letzten Update verändert hat.”

ChatGPT / Claude

Abschnitt betitelt „ChatGPT / Claude“- Inhalt aus

.galataj/live-performance.mdkopieren - In den Chat einfügen

- Ihre Frage stellen

Beispiel:

“Hier sind meine Profiling-Daten. Warum ist OrderService.findAll so langsam?”

GitHub Copilot

Abschnitt betitelt „GitHub Copilot““@.galataj/live-performance.md analysiere die 5 langsamsten Methoden”

Integrierte Prompts

Abschnitt betitelt „Integrierte Prompts“GalataJ enthält vorgefertigte Prompts für die Performance-Analyse.

Prompts aufrufen

Abschnitt betitelt „Prompts aufrufen“IntelliJ: Profiler-Panel → Dropdown Ask AI

VS Code: GalataJ-Panel → Dropdown Ask AI

Verfügbare Prompts

Abschnitt betitelt „Verfügbare Prompts“Regressionen analysieren

Performance-Probleme und Engpässe finden

Optimierungen vorschlagen

Konkrete Code-Verbesserungen erhalten

Speicheranalyse

Allokationsprobleme und GC-Last identifizieren

IO vs. CPU

Feststellen, ob Methoden IO- oder CPU-lastig sind

Eigene Prompts

Abschnitt betitelt „Eigene Prompts“Sie können eigene Prompts hinzufügen, die neben den integrierten erscheinen.

Eigenen Prompt hinzufügen

Abschnitt betitelt „Eigenen Prompt hinzufügen“IntelliJ: Profiler-Panel → Ask AI → Manage Custom Prompts

VS Code: GalataJ-Panel → Ask AI → Manage Custom Prompts

In Chat einfügen

Abschnitt betitelt „In Chat einfügen“Mit der Maus über eine Methode im Profiler-Panel → Add to Chat

Die Metriken der Methode werden direkt in Ihr KI-Gespräch übernommen.

Tipps für bessere Ergebnisse

Abschnitt betitelt „Tipps für bessere Ergebnisse“Seien Sie konkret

Statt „Warum ist meine App langsam?“ fragen Sie: „Warum braucht UserService.findAll 200 ms, wenn die Baseline 20 ms war?“

Kontext angeben

Erwähnen Sie Ihren Tech-Stack: „Spring Boot 3 mit PostgreSQL“

Vorschläge prüfen

KI-Vorschläge sind Ausgangspunkte. Nach Änderungen immer erneut profilieren.

Nächste Schritte

Abschnitt betitelt „Nächste Schritte“- Sitzungsverlauf — Sitzungen für KI-Analyse speichern

- Metriken verstehen — Wissen, wonach Sie fragen